3.0 Descrizione dell’Autofocus.

In seguito ha quanto ho scritto nel capitolo § 2.0 sulla necessità di conoscere il funzionamento dell’Autofocus, prima di procedere alla descrizione delle prove eseguite, descrivo brevemente come l’Autofocus rivela la corretta distanza statica del fuoco.

La maggior parte delle informazioni, e anche un paio di figure, sono tratte da:

APPLIED PHOTOGRAPHIC OPTICS

Sidney F. Ray

Focal Press

ISBN 0-24051540-4

Un ottimo libro che copre quasi tutti gli aspetti tecnici dell’ottica fotografica e non dovrebbe mancare nella biblioteca di chi si occupa di fotografia. Sono d’accordo che la cosa importante è il piacere estetico dell’immagine finale, ma ottenerlo senza conoscere la tecnologia che sta alla base, è difficile. Il puro caso, nei grandi numeri aiuta, ma non è un indice di alta levatura.

Il funzionamento dinamico lo tralascio, sia perché dipende da algoritmi che mi sono ignoti, sia perché non sono in grado di misurarlo con sufficiente precisione.

Il funzionamento statico dell’Autofocus dovrebbe essere già noto a tutti, ma, in conformità a quanto ho scritto nel capitolo § 1.3, inserisco ugualmente la descrizione poiché, anche se non aggiunge nulla di nuovo alle conoscenze dei lettori, può essere ugualmente utile in quanto evidenzia i limiti delle mie conoscenze.

Limiti da tenere presenti nella lettura dei prossimi capitoli.

Per rivelare il fuoco esatto, nel corso del tempo sono stati sviluppati numerosi sistemi ma sulle fotocamere digitali recenti né sono rimasti in uso solo due (come principio di funzionamento, poi esistono le varianti).

Tipo 1) Analisi del contrasto di alcune parti dell’immagine. È chiamato “a contrasto d’immagine”, abbreviato in “a contrasto”.

Tipo 2) Analisi di una piccola area del soggetto, ripresa da due punti dell’obiettivo opposti e simmetrici rispetto all’asse ottico.

È chiamato “a correlazione di fase” o “a comparazione di fase”. A volte anche ”a contrasto di fase” ma quest’ultimo termine non è corretto.

Questi due sistemi sono compatibili tra loro e nulla vieta che in una stessa fotocamera siano usati entrambi.

Prima di elencare i pro e i contro dei due sistemi, una precisazione. Entrambi questi sistemi sono passivi, quindi:

– La luminosità dell’ambiente deve essere superiore a un valore minimo.

Il valore dipende dal modello di AF e dal soggetto, ma non può essere zero perché senza luce non c’è contrasto è il contrasto è necessario per entrambi i sistemi.

– La luminosità non può essere superiore ad un valore massimo, altrimenti il sensore AF satura e il contrasto è ugualmente zero, come in assenza di luce.

Io non ho mai incontrato questo limite, però esiste.

– Il contrasto deve essere maggiore di un minimo.

Il valore dipende dal modello.

– Partendo da un’immagine completamente defocalizzata potrebbe non funzionare a causa del contrasto iniziale vicino a zero.

Io non ho mai incontrato questo limite e non so nemmeno se esiste realmente.

Tipo 1).

È il sistema usato sia sulle Reflex amatoriali sia sugli apparecchi di larga diffusione, come bridge, compatte, telefonini, ecc.

Si divide in due sottotipi basati sul medesimo principio ma diversi per l’implementazione:

Tipo 1a)

Per l’analisi del fuoco usa il sensore immagine della fotocamera.

Tipo 1b)

Per l’analisi del fuoco usa un sensore separato che chiamo: sensore AF.

Tipo 1a).

È il sistema più economico e, come tale, è usato su tutti gli apparecchi dove il costo ha un’importanza fondamentale, ma ha anche dei vantaggi tecnici non trascurabili.

Pro.

– Non richiede Hardware aggiuntivo e la meccanica della macchina è semplificata al massimo. Cosa ottima per l’affidabilità e la durata.

– Analizza direttamente l’immagine ripresa, perciò non ci sono errori né di posizione né di allineamento e non richiede tarature.

– I parametri dei pixel del sensore sono mappati in memoria alla costruzione e tutti i pixel si possono ritenere identici.

– Avendo i pixel separati in RGB, alcuni effetti dell’aberrazione cromatica si possono ridurre da software.

– È indipendente dal diametro della pupilla d’uscita dell’obiettivo.

– L’analisi è flessibile, dipende solo dal software e si può sempre aggiornare (nota 3.0.1).

Contro.

– È lento (nota 3.0.2).

– Usando i piccoli pixel del sensore è meno sensibile di un modulo dedicato che può usare pixel rettangolari di area maggiore.

– Richiede che il sensore d’immagine sia sempre attivo e questo comporta alcuni svantaggi nella progettazione e nell’uso di detto sensore, ma sono gli stessi del Live View. Sulle Reflex più moderne, quindi, non peggiora nulla, poiché quello che poteva peggiorare è già stato peggiorato.

Nota 3.0.1).

La flessibilità dipende dalla tecnologia del sensore. I sensori a CMOS consentono di leggere ciò, e solo ciò, che si desidera. La flessibilità è, quindi, totale.

I CCD, invece, sono letti serialmente e si deve leggere o tutto il sensore o delle aree predisposte in fase di progetto. Nel primo caso la flessibilità è totale ma la lettura porta via molto tempo. Nel molto più probabile secondo caso, si risparmia tempo ma la flessibilità è persa poiché si può leggere solo la parte predisposta.

Esattamente come con il modulo dedicato di 1b).

Nota 3.0.2).

È lentissimo se legge tutto il sensore, ma è lento anche con una lettura parziale perché l’algoritmo per determinare il contrasto (acquisizione dell’immagine + lettura + calcolo) deve essere eseguito ad ogni passo del motore. Vale anche per il tipo 1b) ma il tipo 1a), avendo i pixel più piccoli, richiede un tempo d’esposizione maggiore. Tempo d’esposizione che non è trascurabile, come si potrebbe pensare a primavista, perché é moltiplicato per il numero dei passi con cui è mosso l’obiettivo.

Tipo 1b).

La Canon lo usa su tutte le Reflex amatoriali, anche su quelle più recenti, fornite di Live View, che, come opzione, potrebbero usare entrambi i tipi, sia 1a) sia 1b).

Naturalmente, essendo basato sul medesimo principio fisico, condivide la maggioranza delle caratteristiche con il tipo 1a). Differisce solo perché l’area del soggetto, utilizzata per la messa a fuoco, non è letta direttamente dal sensore d’immagine ma è raccolta da un modulo separato. Questo comporta un maggior costo e alcuni vantaggi tecnici, ma anche alcuni svantaggi, vediamo:

Pro.

– L’elaborazione è più rapida perché il sensore AF è progettato in modo da eliminare alcune manovre meccaniche.

– Il sensore AF è ottimizzato per la funzione. Ad esempio, può usare pixel rettangolari che hanno una maggior area di raccolta luce, con vantaggi per la sensibilità, il rumore, il tempo d’esposizione e altre cose. In pratica funziona con luce inferiore al tipo 1a) ed è più veloce.

Contro.

– Complica la meccanica perché la luce deve andare da due parti (In pochi casi da tre).

– Il sensore AF è monocromatico e gli effetti negativi dell’aberrazione cromatica non si possono ridurre con algoritmi software. Nulla vieta, però, che in futuro il sensore AF sia RGB (sarà, però, un pò meno sensibile).

– Richiede una taratura delicata della distanza per posizionarlo sul medesimo piano focale del sensore d’immagine. Ora è stata introdotta la microregolazione personalizzata che applica un offset di ±10 passi all’obiettivo, ma non so dire nulla né sulla sua efficacia né sulla sua utilità perché non la possiedo. Dieci passi, però, mi sembrano pochi per eliminare la taratura meccanica. Probabilmente le due tarature convivono.

– Le aree analizzate, e le direzioni di analisi, sono fissate dall’hardware e non possono essere modificate.

Tipo 2).

La Canon, per ora, lo monta solo sulle fotocamere professionali della Serie 1.

Sicuramente ciò dipende dal maggior costo ma forse non solo da lui (non conosco l’ingombro ma credo sia maggiore).

L’incremento di costo, credo (ma non né sono sicuro) che sia una frazione non rilevante del costo di una 5D, o fotocamere analoghe che usano il tipo 1b).

Il principio fisico di funzionamento, e le caratteristiche, sono diverse dai due precedenti.

Pro:

– È più preciso specialmente a bassi livelli di contrasto e illuminazione.

– È più veloce.

– Alcuni difetti (ad esempio il micro mosso) si auto-eliminano (anche se non totalmente), poiché sono presenti su entrambi i lati dell’obiettivo.

– È meno sensibile ai valori spuri.

– Misura direttamente la distanza del sensore dal piano focale alla prima esposizione e forse (nota 3.0.3) non richiede di ripetere l’acquisizione dell’immagine ad ogni passo del motore. Una volta acquisita l’immagine, calcola e poi va, o potrebbe andare, direttamente al punto finale.

A logica, la precisione dovrebbe dipendere meno dalla profondità di campo, ma non ho fatto misure poiché non lo possiedo.

Contro

– Non si comporta bene con gli obiettivi dalla pupilla d’uscita molto piccola.

– L’implementazione è naturale solo per il centro dell’immagine.

– È più costoso e, forse, un po’ più ingombrante.

Nota 3.0.3).

Conoscendo la distanza tra il Sensore e il Piano Focale, inviare all’obiettivo il numero di passi necessario senza ripetere l’esposizione è teoricamente possibile ma, come sempre, possono insorgere delle difficoltà pratiche.

· Dei propri obiettivi, già in produzione, la casa conosce tutto ma conservare i parametri anche su quelli futuri significa porre dei vincoli, e i vincoli di solito non sono ben visti.

· Per gli obiettivi di terze parti la conoscenza non esiste. Escluderli totalmente ha due facce. Elimina dei concorrenti sulle ottiche ma agevola i concorrenti sulle fotocamere che consentono una base di ottiche più ampia.

In conclusione l’algoritmo è senz’altro più complesso. Include quasi sicuramente un colloquio tra Obiettivo e Fotocamera per conoscere il rapporto passi/distanza e forse non esegue un unico, singolo, movimento ma più movimenti.

Nota 3.0.4).

Nei pro e nei contro ci sarebbero altre cose, ma non né so abbastanza da inserirle con un minimo di affidabilità.

3.1 Autofocus a Contrasto d’Immagine.

Automatizza la messa a fuoco manuale fatta osservando lo schermo smerigliato.

La descrizione vale sia per il Tipo 1a) sia per il Tipo 1b) poiché il principio fisico è il medesimo.

Principio di funzionamento.

Un obiettivo fotografico generico ricostruisce, sul lato del sensore, un’immagine virtuale che è la(quasi) esatta copia tridimensionale del soggetto.

Per semplicità consideriamo il soggetto non continuo ma diviso in punti grandi un pixel. Ogni punto del soggetto, situato ad una distanza dal punto nodale anteriore, ha un corrispondente punto dal lato immagine, chiamato “punto coniugato”, situato ad una distanza [v] dal punto nodale posteriore che, secondo la famigerata equazione delle lenti:

1/f = 1/u + 1/v vale: v = u*f/(u-f). [3.1.1]

Tutti i punti del soggetto, che si trovano su un medesimo piano, hanno i corrispondenti punti coniugati situati anche loro su un piano speculare dal lato immagine e viceversa. Il sensore è un piano ortogonale all’asse ottico e, quindi, il suo piano speculare dal lato soggetto è anche lui ortogonale all’asse ottico.

Chiamo questo piano ”piano a fuoco”.

Se il soggetto fosse situato tutto su questo piano, esistendo una corrispondenza punto – punto, il contrasto dell’immagine sarebbe il medesimo del soggetto (in realtà un pò inferiore a causa delle aberrazioni dell’obiettivo e del micro mosso) e quindi il massimo possibile.

Quando, invece, questa situazione non si realizza, i suoi punti lontani dal piano a fuoco formano un punto coniugato che non è situato sul sensore ma prima o dopo. Sul sensore, invece, formano un cerchio il cui diametro è tanto più grande, quanto maggiore è la distanza del soggetto dal piano a fuoco. I cerchi hanno un diametro di più pixel e si sovrappongono. Così, allontanandosi dal piano a fuoco il contrasto cala e cala particolarmente il micro contrasto.

Con un soggetto simile, massimizzando il contrasto abbiamo un fuoco perfetto ma gli unici soggetti piatti sono i quadri, le facciate architettoniche e i panorami privi di primo piano. Tutti gli altri hanno punti a distanza diverse e un fuoco perfetto di tutta l’immagine è impossibile. Massimizzare il contrasto dell’intera immagine ha come risultato di mettere a fuoco quel piano ortogonale che minimizza la distanza complessiva di tutti i punti dal piano a fuoco. Una soluzione di compromesso che è molto soggettiva e raramente soddisfacente.

Gli Autofocus, sia di tipo 1a) sia di tipo 1b) non lavorano, perciò, sull’intera immagine ma su brevi segmenti (orizzontali e/o verticali). Un breve segmento è formato da pochi punti ed è facile che siano sul medesimo piano, o poco distanti, specialmente sulle Reflex dove i segmenti sono evidenziati nel mirino e la scelta del segmento, o dei segmenti, da usare è lasciata al fotografo.

Il fatto che sia facile avere tutti i punti di un segmento sul medesimo piano ortogonale all’asse ottico, però, non significa che, anche con un breve segmento, non si possano avere punti a distanze molto diverse e, quindi una messa a fuoco di compromesso.

Poiché sulle Reflex la scelta del segmento (o dei segmenti) è affidata al fotografo, è compito del fotografo scegliere il segmento e disporlo oculatamente in modo da privilegiare, o una messa fuoco di precisione o una messa a fuoco di compromesso, secondo le sue necessità.

Procedura per il calcolo del contrasto (???)

Ho inserito tre punti di domanda per evidenziare che mi è sconosciuta.

Il contrasto è, infatti, una di quelle cose che sappiamo tutti cosa sono, ma che se ci chiedono di spiegarle, non troviamo parole adeguate a tutte le situazioni ma solo a casi specifici. Quest’incertezza affligge anche chi progetta gli algoritmi.

Sui soggetti naturali l’Autofocus è preciso (dal mio punto di vista, altri possono non essere d’accordo). La soluzione, o le soluzioni, trovate le ritengo ottime per la fotografia.

Sui soggetti geometrici artificiali, però, il meccanismo commette degli errori (Capitolo § 7.2), quindi non è ancora completamente esente da problemi.

Faccio, per puro narcisismo e perdita di tempo, qualche ipotesi su qualche ipotetico algoritmo.

1) Calcolo della variabilità totale dell’inquadratura.

Consiste nel sommare tutte le differenze (private del segno e, forse, pesate per privilegiare il micro contrasto) tra un pixel e il successivo.

Funziona bene su soggetti molto vari, anche quando la differenza di luminosità non è elevata, ma la sua sensibilità crolla in presenza di vaste aree uniformi che coprono una parte rilevante dell’area AF. Il micro mosso, inoltre, non diminuisce solo il contrasto ma causa anche una variazione di area AF tra due analisi successive e questo aumenta l’indeterminazione.

2) Simile al punto 1) ma somma le differenze tra ogni pixel e la retta di miglior approssimazione o una media ponderata.

Rispetto al punto 1): funziona meglio con vaste aree uniformi ma è un po’ meno efficace con contrasti deboli e il tempo di calcolo è maggiore.

3) Calcolo della Line Spread Function (LSF) di un bordo.

Funziona bene quando esiste un bordo netto con una differenza di luminosità alta tra i due lati, ma la sua sensibilità crolla quando una di queste due condizioni non è soddisfatta. Richiede inoltre di cercare il bordo più promettente per l’analisi. Ricerca che potrebbe fallire quando in una ridottissima area, posta a una profondità diversa dall’area principale, un bordo è più promettente solo perché in quel momento è più a fuoco.

4) Calcolare la trasformata di Fourier e massimizzare le frequenze più elevate.

È una versione più raffinata dell’algoritmo 1) e i risultati, sulla carta, sembrano molto buoni ma il tempo di calcolo, in assenza di un processore dedicato, è lungo, ed è lunghissimo se non si utilizzano gli algoritmi veloci ma quello generico. Ora, per usare gli algoritmi veloci è necessario che il numero di pixel dei sensori AF sia un numero binario: 64, 128, 256, 512, … poiché la riduzione dei calcoli si basa sulla simmetria delle funzioni trigonometriche.

Il numero è, invece, diverso da quelli indicati. Si può perciò affermare con sicurezza che questo metodo, nonostante la sua efficienza, non è applicato.

Queste considerazioni sono quelle che vengono in mente immediatamente ma né troveremmo altre se dovessimo ragionarci su seriamente per scrivere un algoritmo. Dalle prove di funzionamento al limite (capitoli § 8. …) si può affermare con ragionevole certezza che usa più di un sistema. Uno rapido e immediato, poi sistemi più elaborati se il primo fallisce.

Procedura per la messa a fuoco.

Nel tipo 1a), dove il sensore è su un singolo piano, il procedimento di messa a fuoco comporta diversi movimenti dell’obiettivo.

· Si muove l’obiettivo in una direzione.

· Se il contrasto aumenta, si procede, altrimenti s’inverte il moto.

· Quando il contrasto smette di salire e inizia a scendere significa che si è superato il massimo e si ritorna indietro di un passo (ossia prima che iniziasse la discesa).

Nel tipo 1b) il primo e l’ultimo movimento sono stati eliminati mettendo tre, più raramente due (nota 3.2.1), sensori AF a distanze diverse.

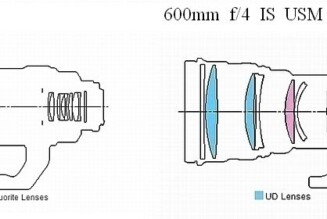

A sinistra (a) è disegnata la soluzione Canon con tre sensori P, F, D, ma le altre sono simili.

Lo specchio principale è semitrasparente. Parte della luce proveniente dall’obiettivo è riflessa verso il mirino/esposimetro. Parte lo attraversa e lo specchio secondario la invia al modulo AF posto in basso (in pochi casi anche a un modulo esposimetrico).

All’ingresso del modulo la luce è divisa in tre da un Beam Splitter triplo e illumina tre schiere di fotosensori lineari ‘P’, ’F’, e ‘D’. I Beam Splitter sono messi uno dopo l’altro e, quindi, i fotosensori si trovano a tre distanze diverse dal piano focale, come si vede nell’immagine a destra (b).

In base al contrasto misurato dai tre sensori AF, il processore della fotocamera conosce, sia la direzione in cui muovere, sia quando fermarsi.

P<F<D = Il piano focale è dopo D. Muovere verso infinito per avvicinare il piano focale.

P>F>D = Il contrario.

P<F>D = È a Fuoco.

Tutto questo se i tre sensori AF sono identici, cosa molto difficile, anche se il chip è unico. I sensori, però, si possono tarare.

Ad esempio, quello d’immagine è misurato e la mappa, con il guadagno e l’offset di ogni pixel, è caricata nella memoria della macchina. A ogni fotografia questa mappa è utilizzata per la correggere le differenze. Lo stesso si può fare per il sensore AF.

Questo è fatto veramente? La Canon in proposito è muta ma credo sia fatto, altrimenti, gli errori di posizione, in caso di poca luce e basso contrasto, potrebbero essere consistenti, invece io li trovo piccoli. Il mio AF è preciso anche con poca luce e poco contrasto.

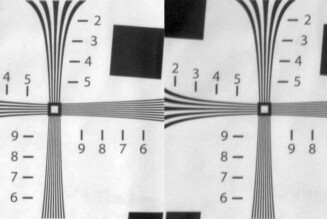

La correlazione tra la fotografia del sensore, a sinistra, e la mappa dei segmenti, a destra, è poco evidente ma le linee nere e grigie sono chiaramente in gruppi di tre come indicato dalla figura 3.1.1.

Una cosa più importante nella mappa a destra è la sensibilità. I segmenti orizzontali funzionano solamente con obiettivi F/2,8 o più aperti. Le varie fotocamere hanno sensori AF diversi e ognuno ha la sua mappa, ma tutti hanno una suddivisione dei segmenti per luminosità. Questo può contribuire a un comportamento dell’AF un po’ diverso tra gli obiettivi molto luminosi e gli altri. Sopratutto quando si abilitano tutti i segmenti per avere la messa a fuoco sul punto più vicino del soggetto.

Nota 3.1.1).

La soluzione con due array è meno efficiente e il costo è quasi uguale.

Nota 3.1.2).

Sul percorso si trovano tre specchi semitrasparenti, il primario e due nel Beam Splitter a tre vie. Tutti e tre polarizzano la luce (naturalmente il piano di polarizzazione è lo stesso). Per questo motivo il filtro polarizzatore deve essere circolare, altrimenti la luce ricevuta dall’autofocus dipenderebbe dall’orientamento del filtro.

Queste due immagini, estratte dalle White Paper Canon, mostrano maggiori dettagli.

Nell’immagine a sinistra (a) è disegnato il percorso dei raggi luminosi (nota 3.1.3).

Le due viti contrassegnate con ‘1’ e ‘2’ sono quelle con cui si tara l’Autofocus (la microregolazione non elimina totalmente la taratura, perché permette solo una piccola personalizzazione). La taratura è eseguita variando l’inclinazione degli specchi. La figura dovrebbe essere sufficiente a scoraggiare chi non ha una buona abilità manuale a tentarlo personalmente.

La stessa immagine illustra anche uno dei motivi per cui i punti di AF sono più sparsi in larghezza che in altezza. Lo specchio secondario può essere largo quanto il primario ma non può essere alto altrettanto. O meglio, in teoria farlo alto uguale non è impossibile, ma significherebbe:

· Raddoppiare la dimensione della fotocamera.

· Ricorrere al retrofocus per gli obiettivi di lunghezza focale inferiore a un medio tele.

· Aumentare il ritardo allo scatto.

Tre cose che sono tutte e tre notevolmente sconvenienti.

Nell’immagine a destra (b) il percorso dei raggi luminosi nella 1D mk IV.

L’ho inserita per mostrare che lo specchio secondario non è sempre un semplice specchio piano. A volte è un componente catrottico che svolge le funzioni di una lente e/o di un divisore di fascio.

Nota 3.1.3).

Il percorso illustrato è quello convenzionale. Le fotocamere con il Live View possono avere un percorso diverso quando il Live View è On (vedi 50D).

Durata dell’Esposizione.

Il tempo di esposizione del sensore AF non è specificato, ma è senz’altro variabile in funzione della luminosità ambiente e di quella dell’obiettivo (il tempo può variare poiché i sensori AF possono avere, e quasi sicuramente hanno, l’otturatore elettronico). I motivi per ritenerlo variabile sono due.

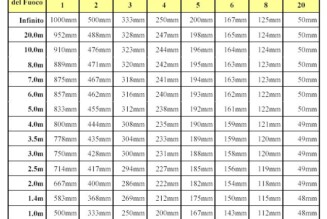

1) L’Autofocus funziona in un intervallo di luminosità che, sulla mia 5Dmk0 (con un obiettivo f/1,4), va da un massimo superiore a 16 EV (nota 3.1.5) a un minimo di 1÷2 EV (capitolo § 8.2). A questi vanno aggiunti i 6 EV dell’obiettivo (da f/1,0 a f/5,6). In totale una dinamica superiore a 20 EV (pari a 1/1.048.576), impossibile da aversi con un tempo di esposizione fisso.

2) Abbassandosi la luminosità, l’Autofocus diventa più lento. Tralasciando, per ora, il limite minimo, la lettura del sensore e i calcoli impiegano un tempo fisso. L’unico tempo che può aumentare all’abbassarsi della luminosità è l’esposizione. Esposizione che, per ridurre il rumore, potrebbe anche essere multipla. A bassi livelli di luminosità, infatti, la curva del contrasto è molto piatta (figura 3.1.4 (a)) e il rumore causa un’incertezza non trascurabile. Non è del tutto impossibile che, tra le varie azioni fatte per ridurlo, possa essere inclusa quella di eseguire la media di più esposizioni.

Nota 3.1.4)

Il valore di 16 EV è la massima luminosità con cui ho fotografato. Non ho misurato il limite superiore con cui funziona (se satura, il contrasto è zero) perché non ho nessuna intenzione di puntare la fotocamera direttamente contro il sole.

Conclusioni.

Il modulo AF a contrasto d’immagine richiede un certo tempo per estrarre il contrasto e, per essere preciso, vuole una curva di contrasto appuntita.

A parità d’incertezza [dC] nella misura del contrasto, la curva (a), ottenuta con poca luce e/o poco contrasto, presenta un’incertezza nella posizione più ampia della curva (b), ottenuta con molta luce e molto contrasto.

Su quest’incertezza si possono dire alcune cose.

La pendenza della curva è proporzionale al diametro del diaframma (e inversamente proporzionale alla profondità di campo), al contrasto del soggetto, alla luce ambiente ed è inversamente proporzionale alla stabilità della fotocamera (nota 3.1.5).

Per un buon funzionamento, perciò, si richiede.

– Un obiettivo luminoso.

– Un soggetto contrastato.

– Una buona luce ambiente.

– Macchina impugnata saldamente (l’obiettivo stabilizzato aiuta moltissimo ma non elimina totalmente il problema) e soggetto immobile.

La curva, vicino al massimo, è sempre un pò piatta, non è mai una cuspide e un’incertezza nella posizione ci sarà sempre.

Quest’incertezza, però, l’ho misurata nei capitoli successivi e, in buone condizioni di luce e di contrasto, l’ho trovata sorprendentemente piccola (sorprendentemente per me).

Nota 3.1.5).

La perdita di definizione, e quindi di contrasto, causata dai piccoli movimenti della fotocamera, e/o del soggetto, è simile a quella causata dalla sfocatura. La curva di figura 3.1.4 (a) si allarga ulteriormente aumentando l’indecisione sulla posizione.

La perdita dovuta al micro mosso dipende dal tempo di acquisizione che è un segreto del fabbricante ben custodito. È sicuramente variabile in funzione della luminosità ambiente e di quella dell’obiettivo (vedi paragrafo precedente) ma io non conosco i tempi.

Comunque, questo è un motivo in più per tenere la fotocamera ben ferma e, per evitare grane, quando si esegue il panning, è più sicuro mettere l’obiettivo in manuale.

3.2 Autofocus a Correlazione di Fase.

Questo sistema fu sviluppato dall’Honeywell nel lontano 1978 per le sue TLC ma fu applicato alle Reflex solo molti anni dopo.

Anche questo sistema automatizza un metodo di messa a fuoco manuale, quello delle macchine a telemetro (o con la maschera di Hartman o Schneider messa sull’obiettivo), dove si sovrappongono due immagini dello stesso soggetto prese da due punti diversi. I due punti prospettici, in questo caso, sono due punti opposti della pupilla d’uscita dell’obiettivo (che per proiezione corrispondono a due punti opposti della pupilla d’ingresso). Questo è lo schema di principio.

La figura a sinistra è tratta dalla richiesta di brevetto 5,923,909 presentata dalla Minolta, ma è quasi identica a quella che si trova nelle White Paper della Canon (manca la maschera 7) e anche in quelle della Nikon. A destra ho disegnato il percorso dei raggi di luce (solo per l’asse X). A causa del resize di Word, il disegno è diventato un po’ piccolino e scolorito ma, per quello che serve, è sufficiente.

Sul piano focale è posta una maschera a croce 7 (non c’è sulle Canon), che elimina la parte inutile dell’immagine per evitare riflessi indesiderati (la Minolta dell’epoca metteva a fuoco solo su una croce centrale), seguita da una lente condensatrice 8 la cui funzione è rendere uniforme l’illuminazione su tutto il sensore. Dopo essersi incrociati al fuoco, i raggi provenienti dall’obiettivo divergono nuovamente. Una parte di questi è raccolta da quattro lenti 9 che riportano i raggi a fuoco su quattro fotosensori lineari (X1, X2, Y1, Y2).

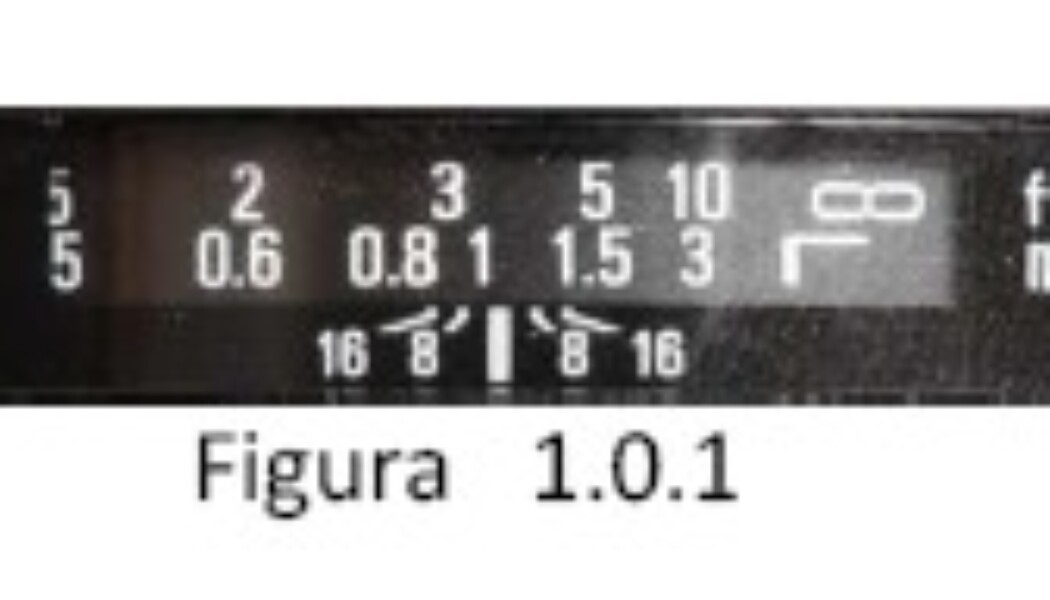

Con il soggetto perfettamente a fuoco, il centro dell’immagine, focalizzata sul sensore AF dalle lenti a’, b’, coincide con il centro della lente stessa. Quando il soggetto è fuori fuoco questa distanza cambia. I centri delle due immagini si avvicinano quando il fuoco cade prima del piano focale (soggetto lontano) e si allontanano quando cade dopo il piano focale (soggetto vicino).

Nota 3.2.1).

I quattro cerchi tratteggiati sull’obiettivo sono la proiezione delle quattro lenti focalizzatrici del modulo.

Lenti che non è detto siano sferiche. Sono quasi sicuramente lenti stampate e può darsi che siano cilindriche poiché devono focalizzare in una sola direzione. Nel mio disegno a destra i diametri di queste proiezioni sono indicati con P1 e P2.

Procedura per la messa a fuoco.

È quasi identica a quella del Tipo 1a/b) ma, essendo tutta elettronica, è veloce.

· Si espone il sensore AF, si legge e si salvano i valori in quattro registri.

· Si calcola la correlazione che, nonostante il nome esotico, è semplicemente la differenza tra i due segmenti lineari ottenuta sommando le differenze (senza segno) tra i corrispondenti pixel dei due segmenti opposti…

· Si muove il contenuto dei due registri in una direzione (o allontanandoli o avvicinandoli).

Sì ricalcola la correlazione. Non occorre rileggere i due sensori AF perché i dati sono già in memoria nei due registri e l’esposizione e la lettura possono essere fatte una volta sola. Tutto il resto sono operazioni di calcolo fatte in memoria e, quindi, veloci (Capitolo § 3.0; nota 3.0.4).

· Se la correlazione è migliore (somma più bassa) si procede, altrimenti s’inverte la direzione di spostamento dei due registri.

· Si continua in questa direzione, spostando e calcolando, fino al miglior indice di correlazione (somma più piccola). Il numero di passi di cui sono stati spostati i registri, moltiplicato per il passo dei pixel, dà le distanze x1 e x2.

Dalla figura 3.2.1 a destra, Il piano focale si deve muovere di: Δ L = f * (1 – B / (x1 + x2)). [3.2]

Questo è fatto per l’asse orizzontale X e per quello verticale Y, in modo da gestire bene sia i soggetti dove sono prevalenti le linee verticali, sia quelli dove sono prevalenti le linee orizzontali. Nel caso le distanze, misurate sugli assi X e Y, siano diverse, è presa quella più vicina.

Per evitare equivoci: la distanza misurata è quella tra il piano a fuoco dal lato immagine e il sensore, non è quella del soggetto fotografato. Le due sono collegate ma, calcolare così la distanza di soggetti lontani è poco preciso a causa della base B piccola (come con le macchine a telemetro).

La correlazione fatta in questo modo è, oggi, più precisa del contrasto per più di un motivo.

Cercare un’uguaglianza rivela differenze più sottili che cercare un massimo non sempre ben definito. Di conseguenza la curva del segnale utile in funzione della distanza dal fuoco è più appuntita di quella in figura 3.1.4 e, a parità di luce e di contrasto, si ha un errore di posizione inferiore, o lo stesso errore si ha con luce e contrasto inferiori.

La curva potrebbe essere resa ancor più appuntita aumentando il diametro delle lenti è/o il numero di pixel del sensore ma entrambi presentano i consueti effetti collaterali. Un maggior diametro delle lenti significa un’area AF maggiore e di conseguenza un fuoco meno puntiforme.

Mentre: più Pixel = Pixel più piccoli = meno sensibilità = più rumore. Il compromesso è necessario.

La maggioranza, sia delle irregolarità sia delle aberrazioni, è presente in quasi ugual misura su entrambe le immagini, e la sottrazione le elimina in gran parte.

Eseguendo (di solito) una sola esposizione, il micro mosso non modifica l’area inquadrata ma anche se le esposizioni fossero multiple, il suo effetto sarebbe simmetrico e sarebbe eliminato.

Esistono, come dappertutto, anche altre costrizioni. Una di queste è l’uguaglianza, dei due sensori AF, Destro↔Sinistro e Alto↔Basso. Ogni pixel di un sensore AF deve essere identico al corrispondente pixel del sensore AF opposto, altrimenti la differenza si somma a quella dell’immagine e può causare un errore di posizione.

Quest’uguaglianza può essere ottenuta per mappatura come per il sensore d’immagine.

La Canon lo fa? Io sono convinto di sì ma non lo dice e il dubbio, pur molto debole, permane.

Nota 3.2.2).

Logicamente in caso di punti a distanze diverse l’Autofocus a correlazione di fase mette a fuoco su un punto intermedio come quello a contrasto.

Nota 3.2.3).

La mia descrizione è ipersemplificata. Le cose, in realtà, sono più complesse, ma per una descrizione di massima credo possa bastare.

Nota 3.2.4).

Sul Web, nelle descrizioni dell’autofocus a correlazione di fase, si parla sempre di prismi (anche su Wikipedia) ma i prismi non centrano una mazza. Credo si tratti di reminescenze dello schermo a immagine spezzata (che si basa su un altro principio) rimaste in un angolino della mente.

3.3 Correlazione di Fase e Pupilla d’Uscita.

Nel precedente capitolo 3.2, la formula [3.2] conferma una cosa lapalissiana.

Come nei telemetri, anche nel modulo a correlazione di fase, aumentando la base (ossia la distanza tra le lenti del modulo), aumenta proporzionalmente la precisione e, perciò, sarebbe ottimo poterla porre ai limiti della pupilla d’uscita dell’obiettivo.

Purtroppo cambiare la separazione delle lenti in funzione dell’obiettivo non è possibile, per motivi evidenti a tutti.

Questa distanza è, quindi, fissata al massimo valore che conserva la compatibilità con tutte le ottiche della casa.

Finché rimaniamo all’interno del sistema fotografico della casa, l’Autofocus, perciò, non ci creerà problemi.

Quando, invece, usiamo obiettivi di terze parti, occorre controllare la pupilla d’uscita, perché se le proiezioni delle lenti non sono contenute all’interno della pupilla stessa, ma debordano, il modulo lavora male, e non funziona per nulla quando sono completamente all’esterno.

Qui ho disegnato i tre casi.

Non conosco il valore della separazione nel modulo AF Canon, ma la pupilla d’uscita degli obiettivi in mio possesso è grande. Il sistema EOS, però, comprende moltissime ottiche tra cui anche dei moltiplicatori di focale, e questi moltiplicano la focale, ma dividono il diametro della pupilla d’uscita. Nessun fabbricante, però, agevola i concorrenti. È possibile, perciò, che la separazione sia al pelo del sistema EOS e alcune ottiche di terze parti restino fuori.

I catadiottrici, ad esempio, di solito hanno una pupilla d’uscita piccola e anulare. Anche alcuni zoom di vecchia progettazione, specialmente se manuali, hanno la pupilla piccola poiché il problema non era sentito.

Davano, è vero, qualche problema con lo schermo a immagine spezzata, che si oscurava, ma si riusciva ad arrangiarsi spostando l’occhio. Con l’Autofocus, invece, se funziona male, non c’è nulla fare. Se il vostro modulo AF è a correlazione di fase, e l’obiettivo Vi da problemi, osservate la pupilla d’uscita. Il diametro, se è molto piccolo, può essere una possibile causa (ma non è necessariamente la causa).

3.4 Taratura.

Il tipo 1a) non richiede nessuna taratura poiché usa il sensore della fotocamera e questo è un grande vantaggio.

I tipi 1b) e 2), invece, mettono a fuoco sul piano focale di un sensore AF separato. È, quindi, necessario tarare la distanza di questo piano focale affinché coincida (come distanza) con il sensore della macchina. Questa taratura si esegue mediante due viti che regolano l’inclinazione degli specchi (figura 3.2.1 (a)). Le viti sono facilmente accessibili dalla baionetta ma la regolazione è delicata. Da tenere presente.

Di fabbrica, e anche dai centri di assistenza, le macchine non escono con una taratura perfetta ma sono tarate con un po’ di Front Focus. Il motivo è pratico.

La profondità di campo vicina è inferiore a quella lontana (figura 2.1.1). Spostando la messa a fuoco un pò in avanti si sposta in avanti anche tutta la profondità di campo che così è più simmetrica rispetto al punto su cui abbiamo fatto l’autofocus e gli errori sono meno evidenti.

Se non accettiamo questo Front Focus perché lavoriamo spesso alla massima apertura, e a piccole distanze, possiamo tararcela personalmente facendo coincidere il piano focale del sensore AF con il piano focale della macchina ma dobbiamo prestare attenzione alle condizioni di contorno.

Nel capitolo 3.1 sono illustrate alcune indeterminazioni che riguardano l’autofocus a contrasto d’immagine. A queste indeterminazioni, intrinseche al sistema, dobbiamo aggiungere quelle ambientali:

· Soggetto fotografato.

· Distanza del soggetto.

· Temperatura.

· Luminosità e contrasto.

· Apertura dell’obiettivo.

· …

Prima di eseguire la taratura, perciò, dobbiamo verificare che l’insieme di tutte queste condizioni non abbia qualche punto critico.

Se non lo facciamo, corriamo il rischio di peggiorare le prestazioni perché tariamo la macchina per una situazione poco frequente. Per quanto riguarda la microregolazione, ossia applicare un certo offset all’obiettivo, occorre prestare attenzione alla distanza a cui si fa perché lo spostamento dell’obiettivo non è lineare con la sfocatura e anche qui il rischio di peggiorare la situazione è sì basso ma non è nullo. Andrà meglio quando introdurranno la microregolazione per ogni distanza.

Una nota a proposito del funzionamento con errori sporadici. Da molti anni è stato introdotto il concetto di Spazio Fotografico.

Questo spazio multidimensionale è delimitato dai valori minimo e massimo di ogni parametro per cui la fotografia riesce tecnicamente corretta. Lo Spazio Fotografico è considerato eccellente quando copre il 95% dei casi statici e il 60% di quelli dinamici.

Si dà, quindi, per scontato che anche i migliori sistemi fotografici causeranno un certo numero di fotografie tecnicamente non buone.

3.5 Soggetto esteso in profondità.

Nel capitolo 3.1 ho scritto che va (quasi)tutto bene quando i punti, inquadrati dal sensore AF, in una singola area, sono tutti alla medesima distanza ma è lapalissiano che funzioni male se i punti sono a profondità diverse. Non è una questione di meccanismi, e/o di algoritmi, ma dei principi basilari dell’ottica.

Possiamo, però, chiederci: “Ma dove mette a fuoco?” ”Ci sono dei limiti?”

La domanda è oziosa sui soggetti statici, poiché dove mette a fuoco, si vede nel mirino ma la situazione è diversa sui soggetti in movimento e gli scatti al volo.

Beh! Tutto ciò che si può dire, è che i limiti esistono e sono dati dal punto più vicino e da quello più lontano.

Non mette mai a fuoco esternamente a questi due estremi ma solo all’interno (gli estremi sono inclusi).

Vediamo il perché iniziando con un’analisi mentale, ossia supponendo che l’Autofocus si comporti come la nostra logica personale ci suggerisce.

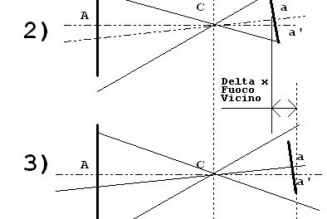

Supponiamo un caso molto semplice, L’area inquadrata dall’Autofocus e distribuita su due piani distinti, ‘A’ vicino e ‘B’ lontano. La distanza tra i due piani non è grande e le due curve di contrasto sono parzialmente sovrapposte. Avremo due contrasti diversi, a causa della differente distanza dei due piani dal fuoco dell’obiettivo.

Uno, Ca, nell’area inquadrata sul piano ‘A’, e uno, Cb, nell’area inquadrata sul piano ”B’.

Eseguiamo una spazzolata spostando gradualmente la messa a fuoco dell’obiettivo dalla distanza minima ad infinito.

– Tra la distanza minima e [A] entrambi i contrasti Ca e Cb sono bassi e l’Autofocus tenderà a spostarsi verso infinito perché, andando in quella direzione, entrambi i contrasti aumentano poiché ci avviciniamo al fuoco.

È, quindi sicuro che non mette a fuoco prima del punto più vicino.

– Quando il fuoco raggiunge [A], Ca raggiunge il massimo e poi inizia a calare. Guardando la figura 3.5.1(a) vediamo che, in corrispondenza del massimo, la curva del contrasto è piuttosto piatta, perciò, Ca cala lentamente mentre Cb continua a salire rapido perché lontano dal suo fuoco. Il totale Ca + Cb continuerà a crescere e l’Autofocus continuerà a spostarsi verso infinito.

– Continuando a spostarsi verso infinito [A] si allontana sempre più dal suo fuoco e il calo diventa più rapido mentre l’aumento di Cb rallenta poiché ci avviciniamo al suo fuoco. A un certo punto il calo di Ca e l’aumento di Cb si uguagliano. È stato raggiunto il massimo. Da qui in poi il contrasto totale cala e l’Autofocus riporterà l’obiettivo indietro verso questo punto. Noi continuiamo imperterriti verso infinito.

– Superato ‘B’ entrambi i contrasti calano perché ci stiamo allontanando da entrambi i fuochi.

L’Autofocus cercherà vieppiù di portare l’obiettivo verso la distanza minima. È, quindi, sicuro che non mette a fuoco dopo il punto più lontano.

Il massimo, quindi, si trova in qualche punto intermedio tra ‘A’ e ‘B’ ma con intermedio non s’intende a metà. S’intende che è in qualche punto tra i due estremi, ma non si sa esattamente dove si trovi, perché la posizione esatta dipende da troppi fattori. Specialmente dal prodotto area x contrasto fornito da ogni piano.

Supponiamo, poi, due aree molto lontane.

In questo caso abbiamo due picchi di contrasto nettamente separati e l’Autofocus, secondo un’analisi superficiale, si porterà o su uno o sull’altro, secondo la pendenza del punto da cui parte.

Questi sono i grafici dei due casi.

Terminata l’analisi, chiamiamola logica, facciamo un esperimento pratico per verificare il comportamento reale spostando gradualmente il segmento dell’Autofocus da ‘A’ a ‘B’.

Il caso (a) è riportato nel capitolo 5.2. Anticipo che si comporta come previsto.

Nel caso (b), invece, sulla mia 5D mk 0, l’algoritmo ha un comportamento più complesso di quanto ho scritto sopra e di quanto immaginavo. Si accorge che ci sono due picchi e, dopo aver esplorato il campo, si posiziona sul picco vicino. Si posiziona su quello lontano solo se oltre il 90% del segmento è su quello lontano.

Condizioni della prova.

Soggetto: Naturale. Il primo è la cupola della Moschea Blu a Istanbul (stampa of course) ma né ho provati altri con contrasti diversi.

[A]: Distanza 0,5 m; (max. 1 m); ‘B’: Distanza 3.0 m su una parete bianca per evitare effetti spuri; (max. 5 m);

Luce incidente . = 10 EV; (min. 6 EV);

Focale . . . = 50 mm; (Sigma);

Diaframma . . = F/1,4; (min. F/5,6);

Messa a fuoco . . = Punto Centrale;

Immagine complessiva dal punto di ripresa.

A seconda delle distanze, del contrasto, del diaframma, della focale e del tipo d’immagine si hanno comportamenti quantitativi diversi ma qualitativamente simili. Ossia mette a fuoco sul punto più vicino ma, prima di farlo, può essere più o meno indeciso. Importante: Non ho misurato l’errore finale.

Queste sono le condizioni di maggior indecisione che ho trovato. In blu la serigrafia, in verde l’area misurata nel capitolo 5.1.

Partendo dal basso e salendo fino al punto 1 mette a fuoco immediatamente sull’immagine vicina.

Tra i punti 1 e 2 fa un paio’ di avanti e indietro, a volte per tutta la corsa, altre solo per un breve tratto (dipende da luce e contrasto), poi mette a fuoco sull’immagine vicina.

Attorno al punto 2 è molto indeciso. Fa diversi avanti e indietro (anche molti) per tutta la corsa poi mette a fuoco sull’immagine vicina.

Sopra il punto 2 mette a fuoco sull’immagine lontana, inizialmente con un po’ di va e vieni.

Come fa l’Autofocus ad accorgersi dei due picchi?

Esplora, forse, gli altri punti AF inclusi quelli invisibili?

Non né ho idea ma il fatto che basti pochissimo primo piano per spostare il fuoco dallo sfondo non va trascurato.

Un consiglio per concludere.

L’algoritmo dell’Autofocus è un algoritmo con tanta buona volontà. Quando la situazione è difficile, prima di dichiararsi vinto le prova tutte e, a volte, ha successo.

Naturalmente il fotografo deve concedergli il tempo necessario.

Non si deve essere precipitosi, la fotografia richiede pazienza.

Premere fulmineamente il pulsante di scatto non va bene, meglio attendere a metà, fino al consenso o alla dichiarazione d’impotenza.